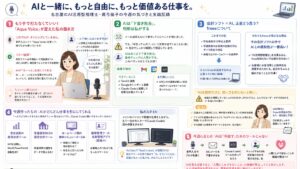

1. AIは「便利な道具」から「頼れるパートナー」へ!

2024年から2025年にかけて、私たちとAIの付き合い方は大きく変わりました。 ちょっと前までのAIは、入力した分だけ結果を返してくれる高機能な電卓のような道具でしたよね。でも今の最新AIは、自ら考えて判断し、行動する「AIエージェント(自律型AI)」へと進化しています。

…かくいう私がAIを本格的にさわり始めたのは、昨年の秋ごろです💦仕事が忙しく余裕がありませんでした。あのまま前職を辞めなかったら、ここまでAIについて知らなかったし、活用できてなかったと思います。そう思うと少し怖い気もします…。

2024年9月に登場した「OpenAI o1」などのモデルは、ただ答えをポンと出すだけでなく、人間のように筋道を立てて考える力(思考の連鎖)を持っています。さらに、過去の会話を覚えてくれたり、画像や音声を扱えたりと、もはや指示待ちの下請け業者ではなく、あなたの隣で一緒にプロジェクトを進めてくれる「パートナー」になりました。

人を雇用する私にとっては、本当にありがたい存在です。以前だったら、半日かけていたかもしれない提案資料がこの前30分もかからずできてしまいました。

💡 ちょっと豆知識:推論型モデルとAIエージェントの違い 「推論型モデル(o1など)」は、答える前にじっくり多段階の思考を行うAIのこと。一方「AIエージェント」は、目的のために自分で計画を立てて行動する仕組みのことです。関連していますが、実は少し違う概念です。

ただ、AIを活用する中で必ず知っておかないといけないことがあります。今日は、その必須事項について記事を書きたいと思います。

2. まずは知っておきたい!AIの2つの癖

AIは驚くほど賢いですが、私たち人間とは全く違う頭の働きをしています。初心者が必ずぶつかる2つの癖を、身近な例えで解説しますね。

① ハルシネーション:悪気のない知ったかぶり

AIは、膨大なデータから「次に来る確率が高い言葉」を繋ぎ合わせているだけです。だから、本当はわからないことでも、「プライドが高くて『知りません』と言えない超エリート新入社員」のように、もっともらしい嘘をつくことがあります。これがハルシネーションです。

-

実際のトラブル例: 2023年、アメリカの弁護士がChatGPTで訴訟の資料を作った際、AIが「実在しない6つの判例」をでっち上げました。それを弁護士はそのまま裁判所に提出してしまいました。

-

ここがポイント: 「AIが言っているから正しいだろう」という思い込みは、あなたの信用を落としてしまう危険な罠になります。固有名詞や数字などの事実は、必ず自分で裏取りしましょう。

② バイアス:色のついた度付きメガネ

AIはインターネット上の膨大な情報を食べて育ちましたが、その情報には人間の偏見や差別も混ざっています。つまり、AIは無意識に「偏った常識」という色メガネをかけて世界を見ているんです。

-

実際のトラブル例: 過去の「男性中心の採用データ」を学習してしまったAIが、女性の応募者を不当に低く評価してしまう事件がありました。

-

ここがポイント: AIの判断をそのまま鵜呑みにすると、知らず知らずのうちに差別や不公平に加担してしまうかもしれません。AIの提案に不公平な偏りがないか、倫理的な目でチェックすることが大切です。

3. 絶対NG!AIに入力してはいけない情報

AIにポチッと情報を入力するのは、リスクがあります。

2023年、サムスン電子のエンジニアが機密のソースコードや会議メモをChatGPTに入力してしまい、情報流出のリスクから社内での利用が原則禁止になるという大きなニュースがありました。

💡 補足:この事件は「他人に情報が漏れた」というより、「外部サーバーに保存されたデータを自社で管理・削除できなくなった」ことが大きな問題でした。

【厳禁】AIに入れてはいけない3大情報 これらを入力しないようにして下さい。

-

個人情報:お客様の名前、住所、メールアドレス、マイナンバーなど。

-

社外秘・機密情報:未発表の計画、独自のソースコード、契約書、ノウハウなど。

-

ID・パスワード:システムのログイン情報や認証キー。

🛡️ セキュリティの豆知識 多くのAIサービスでは、自分のデータを学習に使わせない「オプトアウト」という設定ができます。でも、設定しても運営側のサーバーには一定期間データが残ってしまいます。仕事で使うなら、セキュリティがガッチリ守られた「法人向けプラン」を使うのが鉄則です!

4. 究極の安全策はファクトチェックの習慣化

AIのおかげで検索して答えを探す手間は減りましたが、代わりに自分で考えなくなるという心配も出てきました。 情報の真偽を見抜く力が大事になってきます。

【ファクトチェックの4ステップ】 AIの答えはそのまま使わず、必ずこの検問を通しましょう。

-

健全な疑いを持つ:「AIは平気で嘘もつくし、偏見もある」という前提で接する。

-

出所を確認する:AIに「その根拠(ソース)を教えて」と聞き、公的機関や専門誌の裏付けがあるかチェックする。

-

複数で比べる:1つのAIだけでなく、他のAI(ClaudeやGeminiなど)やGoogle検索も使って情報が一致するか確かめる。

-

最後は人間が判断する:それを本当に使っていいか、倫理的・論理的に正しいかを決めるのは「責任を持てる人間(=あなた)」です。

👑 上級者テクニック:AIに自己批判させる! AIから回答を引き出した後、こんなプロンプト(指示)を出してみてください。 「今のあなたの回答に、ハルシネーションや事実誤認は含まれていませんか?批判的な視点で再検証して、怪しい箇所を教えてください」 これ、すごく効果的ですよ!

※ちなみに私がよくやるのは、最初のプロンプトに「わからない事はわからないと出力して下さい。推論は絶対にしないで下さい。」と入力するのと、3で記載した複数のAIで確かめる方法、実際にあやしいところは自分で調べます。また、ジェンスパークのファクトチェックが優秀なので、ジェンスパークに記事をもっていって、ファクトチェックをお願いしています✨…ただ、課金していないためすぐに限界がきます😢

5. 明日からできる!AI活用のチェックリスト

AIを使いこなすことは、これからの時代を生き抜くために必須です。AIに指示を出す前に、この3秒チェックを習慣にしましょう!

-

セキュリティ:学習オフ(オプトアウト)の設定はした?(会社の秘密を守るため)

-

機密性:入力欄に個人名や重要なコードは入っていない?(消えないデジタルタトゥーを防ぐため)

-

真偽検証:出てきた答えのファクトチェックはした?(AIの知ったかぶりに騙されないため)

これからは、「指示されたことをただこなす人」の仕事はAIに置き換わっていくかもしれません。 私たちが目指すべきは、AIをうまく活用して生産性を爆上げして付加価値を生み出していくような人材ではないでしょうか。